如果你能识别这些图像中的内容 那说明你比AI更聪明

近年来,计算机视觉有了很大的改进,但它仍然能够造成严重的错误。因此,有一整个研究领域致力于研究人工智能经常被误识别的图片,称为“对抗性图像”。将它们视为计算机的视觉幻象。当你看到一棵树上的猫时,AI会看到一只松鼠。

非常需要研究这些图像。由于我们将机器视觉系统置于AI安全摄像头和自动驾驶汽车等新技术的核心,我们相信计算机以与我们相同的方式看世界。对抗性图像证明他们没有。

对抗性图像利用机器学习系统中的弱点

但是,虽然这个领域的很多注意力都集中在专门设计用来愚弄AI的图片上(就像谷歌的算法错误用于枪的3D打印龟),但这些混乱的视觉效果自然也会发生。如果有的话,这类图像更令人担忧,因为它表明视觉系统可以产生非受迫性错误。

为了证明这一点,来自加州大学伯克利分校,华盛顿大学和芝加哥大学的一组研究人员创建了大约7,500个“天然对抗性实例”的数据集。他们根据这些数据测试了许多机器视觉系统,并发现它们的准确率下降了90%,软件在某些情况下只能识别出2%或3%的图像。

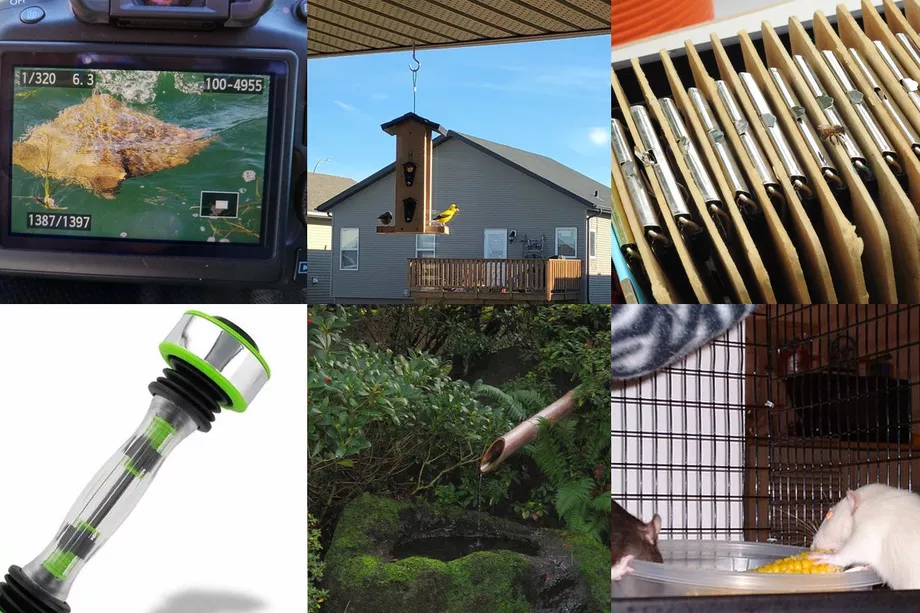

您可以在下面的图库中看到这些“自然对抗性示例”的样子:

在一篇随附的论文中,研究人员称这些数据有望帮助培养更强大的视觉系统。他们解释说,这些图像利用了“深层缺陷”,这些缺陷源于该软件“过度依赖颜色,纹理和背景线索”来识别它所看到的东西。

例如,在下面的图像中,AI错误地将左侧的图片作为钉子,可能是因为木制背景。在右边的图像中,它们专注于蜂鸟饲养器,但却错过了没有真正的蜂鸟存在的事实。

在下面的蜻蜓的四个图像中,AI在颜色和纹理上进行着色,从左到右看到臭鼬,香蕉,海狮和手套。在每种情况下,你都可以看出为什么会犯错误,但这并不会让它变得不那么明显。

AI系统犯这些错误并不是新闻。多年来,研究人员一直警告说,使用深度学习(一种机器学习的风格,负责人工智能最近的许多进展)创建的视觉系统是“浅薄的”和“脆弱的” - 这意味着他们不会理解具有相同细微差别的世界作为一个人的灵活性。

这些系统在成千上万的示例图像上进行了训练,以便了解事物的样子,但我们通常不知道图片AI中的哪些确切元素用于做出判断。

一些研究表明,考虑到整体形状和内容,算法不是从整体上看图像,而是专注于特定的纹理和细节。这个数据集中提供的结果似乎支持这种解释,例如,在明亮的表面上显示清晰阴影的图片被错误地标识为日..人工智能基本上缺少树木。

但这是否意味着这些机器视觉系统无法挽回?一点也不。通常,所犯的错误非常微不足道,例如将排水盖识别为沙井或将货车误认为豪华轿车。

虽然研究人员说这些“自然对抗性的例子”会愚弄各种各样的视觉系统,但这并不意味着他们会欺骗所有人。许多机器视觉系统非常专业,例如用于识别医学扫描中的疾病的那些。虽然它们有自己的缺点,但它们无法理解世界和人类并不能阻止它们发现癌症。

机器视觉有时可能会很快而且很脏,但通常会产生结果。像这样的研究向我们展示了我们接下来需要填补的盲点。